Einführung in neuronale Netze (+ 5 Lernressourcen)

Künstliche neuronale Netze wurden mit dem Ziel entwickelt, die komplexen Verbindungen von Neuronen im menschlichen Nervensystem nachzubilden.

Die Annahme war, dass das biologische Nervensystem, aufgrund seiner Effizienz bei der Signalübertragung und -verarbeitung, ein Weg sein könnte, menschenähnliche Intelligenz in Maschinen zu implementieren.

So entstand ein Netzwerk künstlicher Neuronen, die Daten ähnlich wie ein Verbund von Neuronen im menschlichen Gehirn verarbeiten und weiterleiten können.

Dies führte zu einer signifikanten Verbesserung der Fähigkeit von Maschinen, intelligent zu lernen und zu reagieren, und markierte den Beginn der Ära neuronaler Netze.

Dieser Artikel wird sich mit neuronalen Netzen, ihrer Funktionsweise, ihren Vorteilen und anderen relevanten Aspekten auseinandersetzen.

Legen wir los!

Was sind neuronale Netze?

Bildquelle: Tibco.com

Neuronale Netze, auch bekannt als künstliche neuronale Netze (KNNs), sind ein Bereich der künstlichen Intelligenz (KI) und des maschinellen Lernens (ML), der Maschinen/Computern beibringt, Informationen ähnlich wie das biologische Gehirn zu verarbeiten. Das Netzwerk zeichnet sich durch ein anpassungsfähiges System aus, das es ihm ermöglicht, aus vergangenen Aktionen zu lernen und sich stetig zu verbessern.

Neuronale Netze sind eine Unterkategorie des maschinellen Lernens und basieren auf Deep-Learning-Algorithmen. Die Bezeichnung "neuronales Netz" ist inspiriert von der komplexen Struktur von Neuronen im menschlichen Gehirn und deren Art der Kommunikation.

Das neuronale Netz nutzt Trainingsdaten als Input, um das Lernen zu erleichtern und seine Fähigkeiten zu erweitern. Durch kontinuierliches Lernen aus früheren Daten und die damit verbundene Steigerung der Genauigkeit ist es ein mächtiges, modernes Werkzeug geworden.

Die Wurzeln neuronaler Netze reichen zurück in die frühen Tage der Computer. Der erste Ansatz für ein neuronales Netzwerk wurde von Warren McCulloch als Schaltkreis entworfen, der die Funktionen des menschlichen Gehirns nachbilden sollte.

Im Jahr 1958 entwickelte Frank Rosenblatt die erste Version eines künstlichen Perzeptrons. 1982 veröffentlichte John Hopfield einen Artikel über "rekurrente neuronale Netze". Neuronale Netze fanden im Jahr 1988 ausgiebige Anwendung im Bereich der Proteinforschung.

Die Technologie wurde genutzt, um die dreidimensionalen Strukturen von Proteinen vorherzusagen. Bis zum Jahr 1992 wurde ein Algorithmus für die Erkennung von 3D-Objekten entwickelt.

Heutzutage sind neuronale Netze hoch entwickelt und werden in zahlreichen Bereichen eingesetzt, von Gesundheitswesen, Luft- und Raumfahrt, Verteidigung bis hin zu Cybersicherheit, Marketing und Wettervorhersagen.

Wie funktionieren neuronale Netze?

Wie bereits erwähnt, orientiert sich die Entwicklung neuronaler Netze in ihrer Struktur an der neuronalen Architektur des menschlichen Gehirns. Die Neuronen im menschlichen Gehirn bilden ein komplexes, eng vernetztes Netzwerk, über das Signale gesendet und Informationen verarbeitet werden. Diese Funktion der Neuronen wird von neuronalen Netzen nachgeahmt.

Die grundlegende Arbeitsweise neuronaler Netze beruht auf der Vernetzung mehrerer verschiedener Schichten von Neuronen innerhalb des Netzwerks. Jedes Neuron ist über einen Knoten mit einem anderen verbunden.

Es kann Eingaben von der vorhergehenden Schicht empfangen und eine Ausgabe senden, die an die folgende Schicht weitergeleitet wird. Dieser Vorgang wiederholt sich, bis die letzte Schicht eine Entscheidung trifft oder eine Vorhersage macht.

Die Funktionsweise eines neuronalen Netzes lässt sich besser verstehen, wenn man die einzelnen Mechanismen der verschiedenen Schichten betrachtet, durch die die Daten fließen und verarbeitet werden. Eine grundlegende Struktur besteht aus drei Schichten: Input, Hidden und Output.

Eingabeschicht

Diese Schicht des neuronalen Netzes ist zuständig für das Sammeln von Daten aus der externen Umgebung. Nach der Datenerfassung verarbeitet die Schicht diese Daten, analysiert ihren Inhalt und ordnet sie zur besseren Identifizierung einer Kategorie zu. Anschließend werden die Daten an die nächste Schicht weitergeleitet.

Versteckte Schicht

Die Daten für die versteckte Schicht stammen von der Eingabeschicht und anderen versteckten Schichten. Ein neuronales Netzwerk kann eine große Anzahl versteckter Schichten enthalten. Jede dieser Schichten analysiert die Eingaben, die von der vorhergehenden Schicht weitergeleitet wurden. Die Eingabe wird dann weiterverarbeitet und weitergeleitet.

Ausgabeschicht

Die von der letzten versteckten Schicht weitergeleiteten Daten erreichen die Ausgabeschicht. Diese Schicht zeigt das Endergebnis der Datenverarbeitung, die in den vorherigen Schichten des neuronalen Netzes stattgefunden hat. Die Ausgabeschicht kann je nach Eingabe einen oder mehrere Knoten haben.

Bei der Verarbeitung von Binärdaten (1/0, Ja/Nein) wird zum Beispiel ein einziger Ausgabeknoten verwendet. Bei der Verarbeitung von Daten mit mehreren Kategorien werden jedoch mehrere Knoten genutzt.

Die versteckte Schicht ist im Wesentlichen das Deep-Learning-Netzwerk, das Verbindungen zwischen zahlreichen Knoten herstellt. Die Verbindung der Knoten wird durch eine Zahl dargestellt, die als "Gewicht" bezeichnet wird. Sie gibt an, wie stark ein Knoten andere Knoten beeinflussen kann. Ein positiver Wert bedeutet die Fähigkeit, einen anderen Knoten zu erregen, während ein negativer Wert die Fähigkeit angibt, einen anderen Knoten zu unterdrücken.

Typen von neuronalen Netzen

Je nach Art der Anwendung und der Daten werden verschiedene Typen von neuronalen Netzen eingesetzt, die sich in ihrer jeweiligen Struktur unterscheiden. Hier sind einige der Typen neuronaler Netze:

#1. Feed-Forward-Netzwerk

Diese Art von neuronalem Netzwerk enthält mehrere miteinander verbundene versteckte Schichten und Neuronen. Der Informationsfluss erfolgt hier nur in Vorwärtsrichtung, ohne Backpropagation, daher der Name "Feedforward". Eine höhere Anzahl solcher Schichten trägt zur Gewichtsanpassung und somit zum Lernen bei.

#2. Perzeptron

Dies ist die grundlegendste Form eines Netzwerks, die nur aus einem einzigen Neuron besteht. Das Neuron wendet eine Aktivierungsfunktion auf die Eingabe an, um eine binäre Ausgabe zu erzielen. Im Wesentlichen addiert es den Eingabewert und das Gewicht des Knotens und übergibt die Summe an die Aktivierungsfunktion, um die Ausgabe zu erzeugen. In dieser Art von Netzwerk gibt es keine versteckten Schichten.

#3. Mehrschichtiges Perzeptron

Diese Art von neuronalem Netzwerk ermöglicht die Rückpropagation, die im Feedforward-System nicht unterstützt wird. Es umfasst mehrere versteckte Schichten und Aktivierungsfunktionen, die einen bidirektionalen Datenfluss ermöglichen. Eingaben werden vorwärts weitergegeben, während Gewichtungsaktualisierungen rückwärts erfolgen. Je nach Ziel kann die Aktivierungsfunktion verändert werden.

#4. Radial-Basis-Netzwerk

Diese Netzwerkkategorie verwendet eine Schicht von Radial-Basis-Funktions-Neuronen (RBF) zwischen der Eingabe- und der Ausgabeschicht. Diese Neuronen sind in der Lage, die Klassen der verschiedenen Trainingsdaten zu speichern und so Vorhersagen auf unterschiedliche Weise zu treffen. Das Neuron vergleicht die euklidischen Abstände mit tatsächlich gespeicherten Klassen aus dem Merkmalswert der Eingabe.

#5. Faltungsnetzwerk

Dieses neuronale Netzwerk umfasst mehrere Faltungsschichten, die relevante Merkmale aus Eingaben, wie z. B. Bildern, erkennen. Die ersten Schichten fokussieren sich auf Details der niedrigeren Ebene, während die nachfolgenden Schichten Details der höheren Ebene untersuchen. Dieses Netzwerk verwendet eine benutzerdefinierte Matrix oder einen Filter, um Feature-Maps zu erzeugen.

#6. Rekurrentes Netzwerk

Dieses Netzwerk wird verwendet, wenn es darum geht, Vorhersagen aus einer gegebenen Datensequenz abzuleiten. Zeitverzögerte Eingaben der vorherigen Vorhersage sind möglich. Diese werden in der RNN-Datenzelle gespeichert, die ihrerseits als zweite Eingabe für die Vorhersage dient.

#7. Kurzzeitgedächtnis-Netzwerk

Bei dieser Art von neuronalem Netz wird eine zusätzliche, spezielle Speicherzelle verwendet, um Informationen für einen längeren Zeitraum zu speichern und das Problem des verschwindenden Gradienten zu lösen. Logische Gatter werden verwendet, um Ausgaben zu identifizieren, die verwendet oder verworfen werden müssen. Die drei dabei verwendeten logischen Gatter sind Input, Output und Forget.

Vorteile neuronaler Netze

Neuronale Netze bieten viele Vorteile:

- Ihre Struktur ermöglicht die Verarbeitung von Daten, das Erlernen komplexer und nichtlinearer Beziehungen der realen Welt und die Verallgemeinerung des Gelernten, um neue Ergebnisse zu erzeugen.

- Neuronale Netze sind nicht auf bestimmte Eingaben beschränkt. Sie sind in der Lage, Heteroskedastizität zu modellieren und verborgene Zusammenhänge zwischen Daten zu erkennen.

- Ein neuronales Netzwerk kann Daten im gesamten Netzwerk speichern und auch mit unvollständigen Daten arbeiten. Dies schafft Datenredundanz und mindert das Risiko von Datenverlusten.

- Aufgrund redundanter Verbindungen können mehrere Daten gleichzeitig und parallel verarbeitet werden. Dies bedeutet, dass neuronale Netze mehrere Funktionen gleichzeitig ausführen können.

- Die Möglichkeit, die Datenverarbeitung anzupassen, verleiht ihnen eine hohe Fehlertoleranz und ermöglicht es ihnen, sich durch kontinuierliches Training ständig zu verbessern.

- Da das Netzwerk verteilten Speicher verwendet, ist es widerstandsfähig gegen Datenbeschädigung.

- Es kann aus vergangenen Ereignissen lernen und somit Maschinen trainieren, bessere Entscheidungen zu treffen.

Anwendungen neuronaler Netze

- Vorhersage der Börsenperformance: Das mehrschichtige Perzeptron wird häufig verwendet, um die Börsenperformance vorherzusagen und sich auf Veränderungen im Aktienmarkt vorzubereiten. Das System erstellt Prognosen auf der Grundlage von Gewinnkennzahlen, Jahresrenditen und historischen Performance-Daten der Börse.

- Gesichtserkennung: Faltungsnetzwerke werden eingesetzt, um Gesichtserkennungssysteme zu realisieren, die eine bestimmte Gesichts-ID mit einer Liste von Gesichts-IDs in einer Datenbank vergleichen, um eine Übereinstimmung zu finden.

- Analyse des Verhaltens in sozialen Medien: Das mehrschichtige Perzeptron kann verwendet werden, um das Verhalten von Personen in sozialen Medien anhand von virtuellen Konversationen und Interaktionen zu untersuchen. Diese Daten können für Marketingaktivitäten genutzt werden.

- Luft- und Raumfahrtforschung: Zeitverzögerungsnetzwerke finden in verschiedenen Bereichen der Luftfahrt Anwendung, wie z. B. bei der Mustererkennung, der Sicherung von Steuersystemen, Hochleistungsautopiloten, der Diagnose von Flugzeugfehlern und der Entwicklung von Simulationen. Dies trägt dazu bei, die Sicherheitspraktiken in der Branche zu verbessern.

- Verteidigungsplanung: Verteidigungsstrategien können mithilfe neuronaler Netze entworfen und optimiert werden. Die Technologie kann eingesetzt werden, um Verteidigungsrisiken vorherzusagen, automatisierte Ausrüstung zu steuern und potenzielle Patrouillenpunkte zu identifizieren.

- Gesundheitswesen: Das Netzwerk kann zur Verbesserung von Bildgebungsverfahren für Ultraschall, CT-Scans und Röntgenaufnahmen beitragen. Zudem kann es zu einer effizienteren Erfassung und Verfolgung von Patientendaten beitragen.

- Identitätsprüfung: Muster in der Handschrift können mithilfe neuronaler Netze erkannt werden. Dies kann helfen, potenzielle Fälschungsfälle durch Handschrift- und Signaturverifizierungssysteme aufzudecken.

- Wettervorhersage: Daten von Wettersatelliten können für die dynamische Modellierung und präzisere Vorhersage von Wettermustern genutzt werden. Dies ermöglicht Frühwarnungen vor Naturkatastrophen, um rechtzeitig Vorsichtsmaßnahmen zu treffen.

Lernmittel

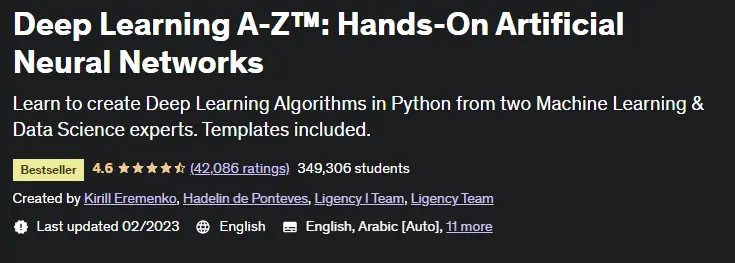

#1. Deep Learning A-Z von Udemy

Deep Learning A-Z von Udemy unterstützt Sie beim Erlernen des Umgangs mit Python und der Entwicklung von Deep-Learning-Algorithmen. Die Kursdauer beträgt 22 Stunden und 33 Minuten.

In diesem Kurs lernen die Studierenden:

- Ein besseres Verständnis für Konzepte der KI, neuronale Netze, selbstorganisierende Karten, Boltzmann-Maschinen und Autoencoder.

- Die praktische Anwendung dieser Technologien in realen Situationen.

Die Kursgebühr beträgt 39,98 $.

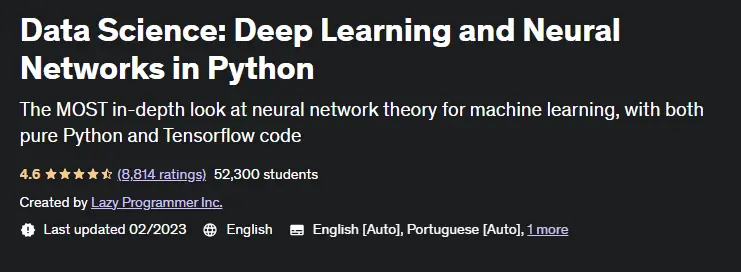

#2. Data Science von Udemy

Data Science ist ein hervorragender Kurs zu Deep Learning und neuronalen Netzen, der die Theorien neuronaler Netze, wie sie im maschinellen Lernen angewendet werden, detailliert behandelt. Dieser Kurs wird ebenfalls von Udemy angeboten und dauert 12 Stunden.

In diesem Kurs lernen die Studierenden:

- Über Deep Learning und die Funktionsweise neuronaler Netze.

- Code für neuronale Netze von Grund auf zu entwickeln.

Die Kursgebühr beträgt 35,13 $.

#3. Erstellen neuronaler Netze von Udemy

Der Udemy-Kurs Building Neural Networks in Python from Scratch versetzt die Lernenden in die Lage, Deep Learning und maschinelles Lernen mithilfe des Gradientenabstiegs und der linearen Regression zu entwickeln. Die Kursdauer beträgt 3 Stunden und 6 Minuten.

In diesem Kurs lernen die Studierenden:

- Über die grundlegenden Funktionen neuronaler Netze, wie lineare Regression, Rückpropagation und Kostenfunktion.

- Neuronale Netze zu trainieren, zu klassifizieren, ihre Lernraten anzupassen, Eingaben zu normalisieren und ihre Genauigkeit zu optimieren.

Die Kursgebühr beträgt 31,50 €.

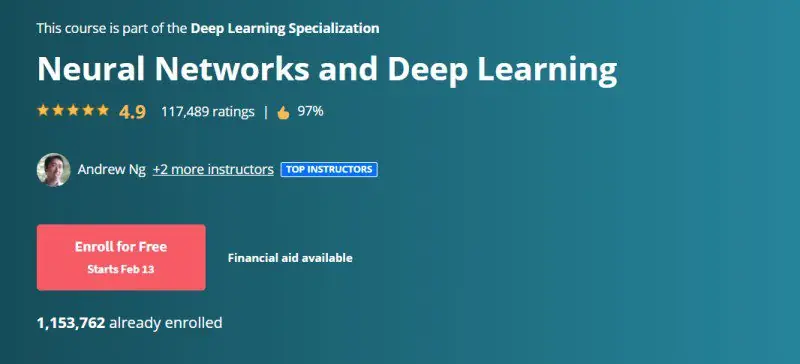

#4. Neuronale Netze und Deep Learning von Coursera

Der Kurs Neural Networks and Deep Learning wird von Coursera angeboten. Er ist der erste Kurs, der sich auf Deep Learning spezialisiert und sich auf die grundlegenden Konzepte konzentriert. Die Kursdauer beträgt 25 Stunden.

In diesem Kurs lernen die Studierenden:

- Die wichtigsten technologischen Trends, die die Entwicklung von Deep Learning vorantreiben.

- Deep Learning zu trainieren und zu nutzen, um ein voll verbundenes Netzwerk zu entwickeln.

Dieser Kurs ist kostenlos.

#5. Aufbau von fortgeschrittenem Deep Learning und NLP

Der Kurs Building Advanced Deep Learning and NLP wird von Educative angeboten. Der Kurs dauert etwa 5 Stunden.

In diesem Kurs lernen die Studierenden:

- In praktischen Programmierumgebungen zu arbeiten.

- Konzepte des Deep Learning kennenzulernen und in Projekten im Zusammenhang mit Natural Language Processing (NLP) und fortgeschrittenem Deep Learning zu üben.

Die Kursgebühr beträgt 9,09 USD pro Monat.

#6. Neuronale Netzwerkprojekte mit Python:

Dieses Buch von James Loy ist ein umfassender Leitfaden zur Verwendung von Python und zur Erforschung der Möglichkeiten künstlicher neuronaler Netze. Sie werden neuronale Netze mithilfe von sechs Python-Projekten, die neuronale Netze nutzen, lernen und implementieren. Nach Abschluss dieses Projekts können Sie Ihr ML-Portfolio aufbauen.

In diesem Kurs lernen die Studierenden:

- Neuronale Netzwerkarchitekturen wie LSTM und CNN.

- Beliebte Bibliotheken wie Keras zu verwenden.

- Projekte umfassen Stimmungsanalyse, Gesichtserkennung, Objekterkennung usw.

#7. Neuronale Netze und Deep Learning

Dieses Buch von Charu C. Aggarwal behandelt moderne und klassische Modelle des Deep Learning. Es vermittelt Ihnen die Algorithmen und die Theorie des Deep Learning und neuronaler Netze, damit Sie diese in verschiedenen Anwendungsbereichen einsetzen können.

Es werden auch Anwendungen wie Empfehlungssysteme, Bildbeschriftung und -klassifizierung, Textanalyse, maschinelle Übersetzung, Spiele und vieles mehr behandelt.

Sie werden lernen:

- Grundlagen neuronaler Netze.

- Fortgeschrittene Themen zu neuronalen Netzen wie GANs, neuronale Turing-Maschinen usw.

Schlussfolgerung

Neuronale Netze sind ein wichtiger Bereich der KI, der das Lernen in einer Weise fördert, die der menschlichen Intelligenz sehr ähnlich ist. Sie umfassen verschiedene Schichten, die jeweils ihre eigene Funktion und Ausgabe haben. Angesichts ihrer Vorteile wie Genauigkeit, Datenverarbeitungskapazität, paralleles Rechnen usw. nehmen die Anwendungen neuronaler Netze in vielen Branchen zu, um Vorhersagen zu treffen und intelligentere Entscheidungen zu ermöglichen.

Sie können auch Faltungsnetze erforschen.