Azok számára, akik nem ismerik a kódolást, nehéz lehet webkaparót létrehozni. Szerencsére a webkaparó szoftver mind a programozók, mind a nem programozók számára elérhető. A webkaparó szoftver kifejezetten a releváns adatok webhelyekről való beszerzésére szolgál. Ezek az eszközök mindenki számára előnyösek, aki valamilyen módon adatokat szeretne szerezni az internetről. Ezek az információk egy helyi fájlban vannak rögzítve a számítógépen vagy egy adatbázisban. Ez az önálló adatgyűjtés technikája a web számára. Felsoroljuk a 31 legjobb ingyenes webkaparó eszköz listáját.

Tartalomjegyzék

31 legjobb webkaparó eszköz

A legjobb webkaparó eszközök válogatott listája itt található. Ez a lista kereskedelmi és nyílt forráskódú eszközöket, valamint a megfelelő webhelyekre mutató hivatkozásokat egyaránt tartalmaz.

1. Túljárni

Az Outwit egy Firefox kiegészítő, amely egyszerűen telepíthető a Firefox kiegészítők boltjából.

- Ez az adatkaparó eszköz megkönnyíti a névjegygyűjtést az internetről és e-mailben.

- Igényeitől függően három lehetőség közül választhat a termék megvásárlásához.

- Pro

-

Szakértő, és

-

Vállalati kiadások állnak rendelkezésre.

- Az Outwit hubot használó webhelyekről származó adatok pontosítása nem igényel programozási ismereteket.

- Elkezdhet kaparni több száz weboldalt egyetlen kattintással a felfedező gombra.

2. PareseHub

A ParseHub az egyik legjobb ingyenes webkaparó eszköz.

- Az adatok letöltése előtt tisztítsa meg a szöveget és a HTML-t.

- Ez olyan egyszerű, mint kifinomult webkaparónk segítségével kiválasztani a kinyerni kívánt adatokat.

- Ez az egyik legjobb adatkaparó eszköz, mivel lehetővé teszi a lekapart adatok bármilyen formátumban történő tárolását további elemzés céljából.

- Felhasználóbarát grafikus felület

- Ez az internetes kaparóeszköz lehetővé teszi az adatok automatikus gyűjtését és mentését a szervereken.

3. Apify

Az Apify az egyik legjobb webkaparó és automatizálási eszköz, amely lehetővé teszi API-k létrehozását bármely webhelyhez, beépített lakossági és adatközponti proxykkal, amelyek megkönnyítik az adatkinyerést.

- Az Apify gondoskodik az infrastruktúráról és a számlázásról, lehetővé téve a fejlesztők számára, hogy passzív pénzt keressenek mások számára készített eszközök tervezésével.

- Néhány elérhető csatlakozó a Zapier, az Integromat, a Keboola és az Airbyte.

- Az Apify Store kész kaparási megoldásokat kínál olyan népszerű webhelyekhez, mint az Instagram, a Facebook, a Twitter és a Google Maps.

- A JSON, az XML, a CSV, a HTML és az Excel mind letölthető strukturált űrlapok.

- A HTTPS, a földrajzi hely szerinti célzás, az intelligens IP-rotáció és a Google SERP-proxy az Apify Proxy szolgáltatásai.

- Ingyenes 30 napos proxy próbaverzió 5 USD platformjóváírással.

4. Scrapestack

A Scrapestacket több mint 2000 cég használja, és erre az egyedülálló API-ra támaszkodnak, amelyet az apilayer hajt. Ez az egyik legjobb ingyenes webkaparó eszköz.

- Világszerte 35 millió adatközpontból álló IP-címkészletet használ.

- Lehetővé teszi több API-kérés egyidejű végrehajtását.

- A CAPTCHA dekódolás és a JavaScript megjelenítés egyaránt támogatott.

- Ingyenes és fizetős lehetőségek is rendelkezésre állnak.

- A Scrapestack egy online kaparó REST API, amely valós időben működik.

- A scrapestack API lehetővé teszi, hogy ezredmásodpercek alatt lekaparjon weboldalakat több millió proxy IP-cím, böngésző és CAPTCHA használatával.

- A világ több mint 100 különböző helyéről küldhetők webkaparási kérelmek.

5. FMiner

Windows és Mac OS rendszeren az FMiner egy népszerű online kaparási, adatkinyerési, feltérképező képernyőkaparó, makró- és webes támogatási program.

- Az adatok nehezen feltérképezhető dinamikus Web 2.0 webhelyekről gyűjthetők.

- Lehetővé teszi adatkinyerési projekt létrehozását a vizuális szerkesztő segítségével, amely egyszerűen használható.

- A hivatkozásstruktúrák, a legördülő menük és az URL-minta-illesztés kombinációját használja, hogy lehetővé tegye a weboldalak közötti böngészést.

- Használhat harmadik féltől származó automatikus decaptcha-szolgáltatásokat vagy kézi bevitelt a webhely CAPTCHA-védelmének megcélzásához.

6. Sequentum

A Sequentum egy robusztus big data eszköz a megbízható online adatok megszerzéséhez. Ez az egyik legjobb ingyenes webkaparó eszköz.

- Az alternatív megoldásokhoz képest az online adatok kinyerése egyre gyorsabb.

- Ezzel a funkcióval válthat több platform között.

- Ez az egyik legerősebb webkaparó cége növekedéséhez. Egyszerű funkciókat tartalmaz, beleértve a vizuális point-and-click szerkesztőt.

- A dedikált webes API segít a webalkalmazások fejlesztésében, mivel lehetővé teszi a webes adatok futtatását közvetlenül a webhelyéről.

7. Ügynökség

Az Agenty egy adatkaparó, szövegkivonatoló és OCR program, amely Robotic Process Automation rendszert használ.

- Ez a program lehetővé teszi az összes feldolgozott adat újrahasznosítását elemzési célokra.

- Csak néhány egérkattintással készíthet ügynököt.

- A feladat elvégzése után e-mail üzenetet kap.

- Lehetővé teszi a Dropboxhoz való csatlakozást és a biztonságos FTP használatát.

- Az összes eseményhez tartozó tevékenységnapló megtekinthető.

- Segít cége sikerének javításában.

- Lehetővé teszi az üzleti szabályok és az egyéni logika egyszerű megvalósítását.

8. Import.io

Adatok importálásával egy bizonyos weboldalról és az adatok CSV-fájlba exportálásával az import.io webkaparó alkalmazás segít az adatkészletek kialakításában. Ez is az egyik legjobb webkaparó eszköz. Az alábbiakban bemutatjuk ennek az eszköznek a jellemzőit.

- A webes űrlapok/bejelentkezések használata egyszerű.

- Ez az egyik legjobb adatkaparási megoldás az API-k és webhookok kihasználására az adatok alkalmazásokba való integrálására.

- Betekintést nyerhet jelentések, diagramok és vizualizációk révén.

- Az adatkinyerést előre meg kell tervezni.

- Az Import.io felhő lehetővé teszi az adatok tárolását és elérését.

- A webes interakció és a munkafolyamatok automatizálhatók.

9. Webz.io

A Webz.io lehetővé teszi több száz webhely feltérképezését, és azonnali hozzáférést biztosít a strukturált és valós idejű adatokhoz. Ez is az egyik legjobb ingyenes webkaparó eszköz.

Szervezett, géppel olvasható adatkészleteket szerezhet be JSON és XML formátumban.

- Hozzáférést biztosít a több mint tíz évnyi adatot felölelő történeti hírcsatornákhoz.

- Lehetővé teszi az adatfolyamok nagy adatbázisához való hozzáférést anélkül, hogy további költségeket kellene fizetnie.

- Használhat speciális szűrőt a részletes elemzéshez és adatkészletekhez.

10. Skaparó

A Scrape Owl egy könnyen használható és gazdaságos webkaparó platform.

- A Scrape Owl elsődleges célja bármilyen típusú adat lekaparása, beleértve az e-kereskedelmet, az álláshirdetéseket és az ingatlanhirdetéseket.

- Az anyag kibontása előtt egyéni JavaScriptet futtathat.

- A helyeket használhatja a helyi korlátozások megkerülésére és a helyi tartalmak elérésére.

- Megbízható várakozási funkciót biztosít.

- A teljes oldalas JavaScript megjelenítés támogatott.

- Ez az alkalmazás közvetlenül a Google-táblázaton használható.

- 1000 kredit értékű ingyenes próbaverziót kínál, amellyel kipróbálhatja a szolgáltatást a tagság megvásárlása előtt. Nincs szükség hitelkártya használatára.

11. Kaparóméh

A Scrapingbee egy webkaparó API, amely gondoskodik a proxy beállításokról és a fej nélküli böngészőkről.

- Javascriptet tud futtatni az oldalakon, és minden kérésnél elforgatja a proxykat, így a nyers HTML-t anélkül olvashatja, hogy feketelistára kerülne.

- Egy második API is elérhető a Google keresési eredményeinek kinyerésére.

- A JavaScript megjelenítés támogatott.

- Automatikus proxy-forgató funkcióval rendelkezik.

- Ez az alkalmazás közvetlenül a Google Táblázatokon használható.

- A program használatához Chrome webböngésző szükséges.

- Ideális az Amazon kaparáshoz.

- Lehetővé teszi a Google találatainak lekaparását.

12. Fényes adatok

A Bright Data a világ vezető online adatplatformja, amely költséghatékony megoldást kínál a nyilvános webes adatok nagyarányú gyűjtésére, a strukturálatlan adatok egyszerű konvertálására strukturált adatokká, és kiváló ügyfélélményt biztosít, miközben teljes mértékben átlátható és megfelelő.

- Ez a leginkább alkalmazkodó, mivel előre elkészített megoldásokkal érkezik, és bővíthető és állítható.

- A Bright Data következő generációs adatgyűjtője automatizált és személyre szabott adatáramlást biztosít egyetlen irányítópulton, függetlenül a gyűjtemény méretétől.

- A nap 24 órájában, a hét minden napján nyitva tart, és ügyfélszolgálatot kínál.

- Az e-kereskedelmi trendektől és a közösségi hálózatok adataitól a versenytársak intelligenciájáig és piackutatásig az adatkészleteket az Ön vállalkozása igényeihez szabjuk.

- Elsődleges üzleti tevékenységére koncentrálhat, ha automatizálja a megbízható adatokhoz való hozzáférést iparágában.

- Ez a leghatékonyabb, mivel kód nélküli megoldásokat és kevesebb erőforrást használ.

- A legmegbízhatóbb, a legjobb adatminőséggel, magasabb rendelkezésre állási idővel, gyorsabb adatforgalommal és jobb ügyfélszolgálattal.

13. Scraper API

A Scraper API eszközt használhatja a proxy-k, böngészők és CAPTCHA-k kezelésére.

- Az eszköz páratlan sebességet és megbízhatóságot biztosít, lehetővé téve méretezhető webkaparók létrehozását.

- A HTML-kódot bármelyik weboldalról megkaphatja egyetlen API-hívással.

- Egyszerűen beállítható, mivel mindössze egy GET-kérést kell küldenie az API-kulcsával és URL-címével az API-végponthoz.

- Lehetővé teszi a JavaScript egyszerűbb megjelenítését.

- Lehetővé teszi a kérés típusának és fejléceinek testreszabását az egyes kérésekhez.

- Forgó proxyk földrajzi hellyel

14. Dexi Intelligens

A Dexi intelligent egy online kaparó alkalmazás, amely lehetővé teszi, hogy bármilyen mennyiségű webes adatot gyors kereskedelmi értékké alakítson.

- Ezzel az online kaparóeszközzel pénzt és időt takaríthat meg cége számára.

- Javította a termelékenységet, a pontosságot és a minőséget.

- Lehetővé teszi a leggyorsabb és leghatékonyabb adatkinyerést.

- Nagyszabású tudásrögzítő rendszerrel rendelkezik.

15. Diffbot

A Diffbot lehetővé teszi, hogy gyorsan szerezzen be számos fontos tényt az internetről.

- A mesterséges intelligencia kivonóival bármilyen URL-ből pontos strukturált adatokat nyerhet ki.

- Nem kell fizetnie a webhely időigényes lekaparásáért vagy kézi lekérdezéséért.

- Az egyes objektumok teljes és pontos képének létrehozásához számos adatforrás összevonásra kerül.

- Az AI Extractors segítségével bármilyen URL-ből strukturált adatokat nyerhet ki.

- A Crawlbot segítségével több tízezer domainre bővítheti kivonatát.

- A Tudásgráf szolgáltatás pontos, teljes és mélyreható adatokat biztosít az interneten, amelyekre a BI-nak szüksége van ahhoz, hogy értelmes betekintést nyújtson.

16. Data Streamer

A Data Streamer egy olyan technológia, amely lehetővé teszi a közösségi hálózatokhoz kapcsolódó anyagok beszerzését az internet minden részéről.

- Ez az egyik legnagyobb online kaparó, amely természetes nyelvi feldolgozást használ a kulcsfontosságú metaadatok lekérésére.

-

A Kibana és az Elasticsearch integrált teljes szöveges keresést biztosít.

- Információ-visszakereső algoritmusokon, integrált kazán eltávolításon és tartalomkivonáson alapul.

- Hibatűrő infrastruktúrára építve magas szintű információ-elérhetőséget biztosít.

17. Mozenda

A Mozenda segítségével szövegeket, fényképeket és PDF anyagokat kinyerhet a weboldalakról.

- Használhatja a választott Bl eszközt vagy adatbázist az online adatok összegyűjtésére és közzétételére.

- Ez az egyik legjobb online kaparóeszköz az adatfájlok közzétételhez való rendszerezésére és formázására.

- A point-and-click felülettel percek alatt létrehozhat webkaparó ügynököket.

- A webes adatok valós idejű gyűjtéséhez használja a Job Sequencer és a Request Blocking funkciókat.

- A számlavezetés és az ügyfélszolgálat az iparág legjobbjai közé tartozik.

18. Data Miner Chrome bővítmény

A Data Miner böngészőbővítmény megkönnyíti a webkaparást és az adatrögzítést.

- Több oldal feltérképezésére, valamint dinamikus adatkinyerésre is képes.

- Az adatok kiválasztása többféleképpen történhet.

- Megvizsgálja a lekapart információt.

- A kimásolt adatok CSV-fájlként menthetők.

- A helyi tárhely a kimásolt adatok tárolására szolgál.

- A Chrome-bővítmény Web Scraper adatokat gyűjt a dinamikus webhelyekről.

- it A webhelytérképek importálhatók és exportálhatók.

19. Scrapy

A Scrapy emellett az egyik legjobb webkaparó eszköz. Ez egy Python-alapú, nyílt forráskódú online kaparó keretrendszer webkaparók létrehozására.

- Minden olyan eszközt biztosít, amelyre szüksége van ahhoz, hogy gyorsan kinyerje az adatokat a webhelyekről, elemezze azokat, és elmentse azokat az Ön által választott szerkezetben és formátumban.

- Ez az adatkaparó eszköz elengedhetetlen, ha nagy adatkaparási projektje van, és azt szeretné a lehető leghatékonyabbá tenni, ugyanakkor megőrizni a rugalmasságot.

- Az adatok JSON, CSV vagy XML formátumban exportálhatók.

- A Linux, a Mac OS X és a Windows egyaránt támogatott.

- A Twisted aszinkron hálózati technológiára épül, amely az egyik legfontosabb jellemzője.

- A Scrapy egyszerű használatáról, kiterjedt dokumentációjáról és aktív közösségéről nevezetes.

20. ScrapeHero Cloud

A ScrapeHero több éves webes feltérképezési tudását felhasználva gazdaságos és egyszerűen használható előre beépített bejárókká és API-kká változtatta, amelyek segítségével adatokat kaparhat le olyan webhelyekről, mint az Amazon, a Google, a Walmart és mások.

- A ScrapeHero Cloud bejárók magukban foglalják az automatikusan forgó proxykat és a lehetőséget, hogy egyszerre több bejárót is lehessen futtatni.

- A ScrapeHero Cloud használatához nem kell letöltenie vagy megtanulnia, hogyan kell használni az adatkaparó eszközöket vagy szoftvereket.

- A ScrapeHero felhőrobotok segítségével azonnal lekaparhatja az adatokat, és exportálhatja azokat JSON, CSV vagy Excel formátumban.

- A ScrapeHero Cloud ingyenes és egyszerű csomagú kliensei e-mailben kapnak segítséget, míg az összes többi csomag Priority szolgáltatást kap.

- A ScrapeHero Cloud bejárók úgy is konfigurálhatók, hogy megfeleljenek az ügyfelek egyedi igényeinek.

- Ez egy böngésző alapú webkaparó, amely bármilyen webböngészővel működik.

- Nincs szüksége semmilyen programozási tudásra vagy kaparó fejlesztésére; olyan egyszerű, mint a kattintás, másolás és beillesztés!

21. Adatkaparó

A Data Scraper egy ingyenes online adatkaparó alkalmazás, amely egyetlen weboldalról gyűjti le az adatokat, és CSV- vagy XSL-fájlként menti el.

- Ez egy böngészőbővítmény, amely az adatokat ügyes táblázatos formátumba konvertálja.

- A bővítmény telepítéséhez a Google Chrome böngésző használatára van szükség.

- Az ingyenes verzióval havonta 500 oldalt kaparhat össze; de ha több oldalt szeretne kaparni, frissítenie kell valamelyik drága csomagra.

22. Visual Web Ripper

A Visual Web Ripper egy automatikus adatkaparó eszköz webhelyekhez.

- Ezzel az eszközzel az adatstruktúrákat webhelyekről vagy keresési eredményekről gyűjtjük össze.

- Az adatokat CSV-, XML- és Excel-fájlokba exportálhatja, és felhasználóbarát felülettel rendelkezik.

- Adatokat is gyűjthet dinamikus webhelyekről, például azokról, amelyek AJAX-ot használnak.

- Csak be kell állítania néhány sablont, és a webkaparó elintézi a többit.

- A Visual Web Ripper ütemezési lehetőségeket kínál, és még e-mailt is küld, ha egy projekt meghiúsul.

23. Octoparse

Az Octoparse egy felhasználóbarát weboldal-kaparó alkalmazás vizuális felülettel. Ez az egyik legjobb ingyenes webkaparó eszköz. Az alábbiakban bemutatjuk ennek az eszköznek a jellemzőit.

- Mutass és kattints felülete egyszerűvé teszi a webhelyről lemásolni kívánt információk kiválasztását. Az Octoparse statikus és dinamikus weboldalakat is képes kezelni az AJAX-nak, a JavaScript-nek, a cookie-knak és más képességeknek köszönhetően.

- A fejlett felhőszolgáltatások, amelyek lehetővé teszik nagy mennyiségű adat kinyerését, már elérhetőek.

- A kimásolt információk TXT, CSV, HTML vagy XLSX fájlként menthetők.

- Az Octoparse ingyenes verziója lehetővé teszi akár 10 bejáró létrehozását; a fizetett tagsági csomagok azonban olyan funkciókat tartalmaznak, mint az API és számos névtelen IP-proxy, amelyek felgyorsítják a kinyerést, és lehetővé teszik nagy mennyiségű adat letöltését valós időben.

24. Web Harvey

A WebHarvey vizuális webkaparója beépített böngészővel rendelkezik az online webhelyekről származó adatok lemásolásához. Ez is az egyik legjobb webkaparó eszköz. Íme ennek az eszköznek néhány funkciója.

- Mutass és kattints felületet kínál, amely megkönnyíti a tételek kiválasztását.

- Ennek a lehúzónak az az előnye, hogy nem kell kódot írnia.

-

Az adatok mentésére CSV, JSON és XML fájlok használhatók.

- SQL adatbázisba is menthető. A WebHarvey többszintű kategória-lekaparási funkcióval rendelkezik, amely a kategóriakapcsolatok egyes szintjeit követve adatokat tud lekaparni a listaoldalakról.

- Reguláris kifejezések használhatók az internetes kaparóeszközzel, ami további szabadságot biztosít.

- Beállíthat proxyszervert, hogy az IP-címe rejtve maradjon, miközben adatokat von le a webhelyekről, így bizonyos mértékig megőrizheti a magánélet védelmét.

25. PySpider

A PySpider emellett az egyik legjobb ingyenes webkaparó eszköz, amely Python-alapú webrobot. Az alábbiakban felsorolunk néhány funkciót ennek az eszköznek.

- Elosztott architektúrával rendelkezik, és támogatja a Javascript oldalakat.

- Sok bejárója lehet így. A PySpider az Ön által választott bármely háttérrendszeren tárolhat adatokat, beleértve a MongoDB-t, a MySQL-t, a Redis-t és másokat.

- Üzenetsorok, például RabbitMQ, Beanstalk és Redis állnak rendelkezésre.

- A PySpider egyik előnye az egyszerű felhasználói felület, amely lehetővé teszi a szkriptek módosítását, a futó tevékenységek figyelését és az eredmények vizsgálatát.

- Az információk JSON és CSV formátumban tölthetők le.

- A PySpider az az internetes kaparás, amelyet figyelembe kell venni, ha webhely-alapú felhasználói felülettel dolgozik.

- Sok AJAX-ot használó webhelyekkel is működik.

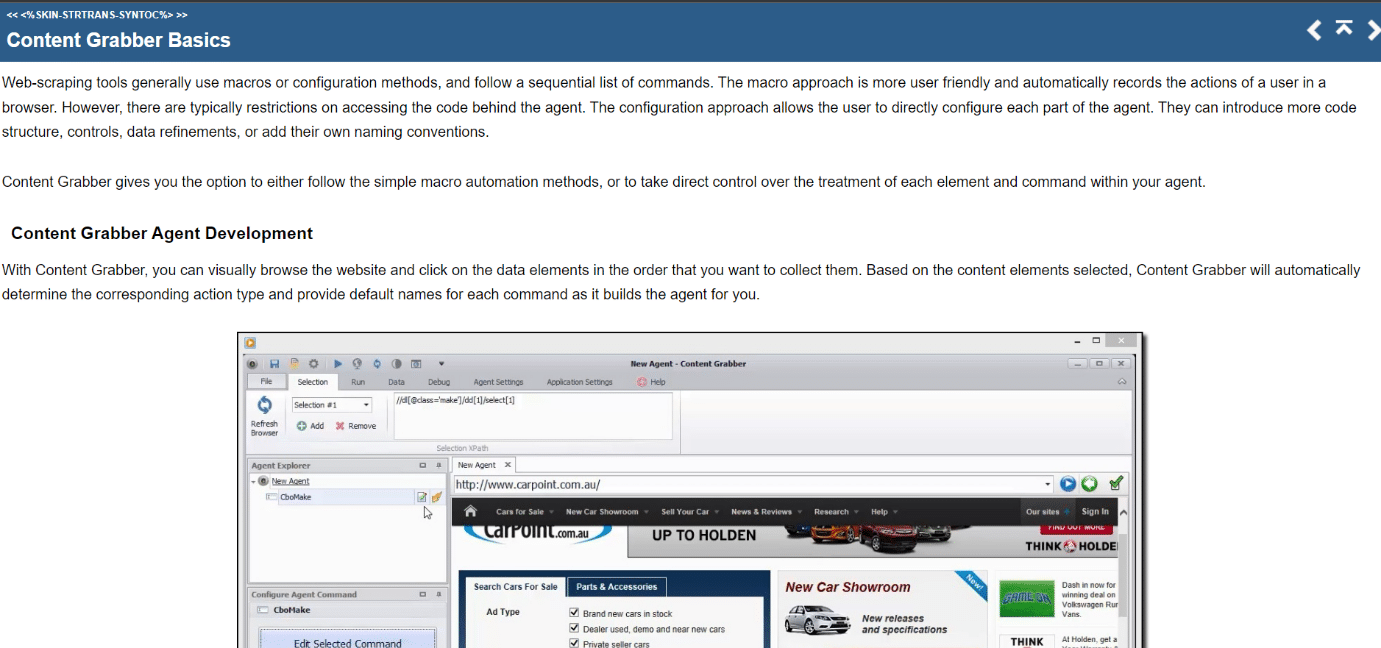

26. Tartalomrabló

A Content Grabber egy vizuális online kaparóeszköz, amely könnyen használható point-and-click felülettel rendelkezik az elemek kiválasztásához. Az alábbiakban bemutatjuk ennek az eszköznek a jellemzőit.

- A CSV, XLSX, JSON és PDF azok a formátumok, amelyekben az adatok exportálhatók. Az eszköz használatához középfokú programozási ismeretek szükségesek.

- Az oldalszámozás, a korlátlan görgetés és az előugró ablakok mind lehetségesek a felhasználói felületen.

- Ezenkívül tartalmaz AJAX/Javascript feldolgozást, captcha megoldást, reguláris kifejezés támogatást és IP-rotációt (Nohodo használatával).

27. Kimurai

A Kimurai egy Ruby webkaparó keretrendszer kaparók létrehozására és adatok kinyerésére. Ez is az egyik legjobb ingyenes webkaparó eszköz. Íme ennek az eszköznek néhány funkciója.

- Lehetővé teszi számunkra, hogy közvetlenül a dobozból kikaparjuk a JavaScript által előállított weboldalakat, és kezeljük azokat Headless Chromium/Firefox, PhantomJS vagy alapvető HTTP-lekérdezések segítségével.

- Hasonló szintaxissal rendelkezik, mint a Scrapy, és konfigurálható opciói vannak, beleértve a késleltetés beállítását, a felhasználói ügynökök forgatását és az alapértelmezett fejléceket.

- A Capybara tesztelési keretrendszer segítségével a weboldalakkal is együttműködik.

28. Cheerio

A Cheerio az egyik legjobb webkaparó eszköz. Ez egy olyan csomag, amely HTML és XML dokumentumokat elemzi, és lehetővé teszi a letöltött adatok kezelését a jQuery szintaxis használatával. Az alábbiakban bemutatjuk ennek az eszköznek a jellemzőit.

- Ha JavaScript webkaparót fejleszt, a Cheerio API gyors választási lehetőséget kínál az adatok elemzéséhez, módosításához és megjelenítéséhez.

- Nem jeleníti meg a kimenetet webböngészőben, nem alkalmaz CSS-t, nem tölt be külső erőforrásokat, és nem futtat JavaScriptet.

- Ha ezen funkciók bármelyikére szükség van, nézze meg a PhantomJS-t vagy a JSDom-ot.

29. Bábos

A Puppeteer egy Node-csomag, amely lehetővé teszi a Google fej nélküli Chrome böngészőjének kezelését egy hatékony, de egyszerű API segítségével. Az alábbiakban felsorolunk néhány funkciót ennek az eszköznek.

- A háttérben fut, és egy API-n keresztül hajtja végre a parancsokat.

- A fej nélküli böngésző olyan, amely képes kérések küldésére és fogadására, de nem rendelkezik grafikus felhasználói felülettel.

- A Puppeteer a megfelelő megoldás a feladatra, ha a keresett információ API adatok és Javascript kód kombinációjával jön létre.

- Utánozhatja a felhasználói élményt úgy, hogy ugyanazokra a helyekre gépel és kattint, ahol ők.

- A Puppeteer arra is használható, hogy képernyőképeket készítsen olyan weboldalakról, amelyek alapértelmezés szerint megjelennek a webböngésző megnyitásakor.

30. Drámaíró

A Playwright egy Microsoft Node könyvtár, amelyet a böngésző automatizálására terveztek. Ez az egyik legjobb ingyenes webkaparó eszköz. Íme ennek az eszköznek néhány funkciója.

- Kompetens, megbízható és gyors, böngészők közötti webautomatizálást kínál.

- A Playwright célja az volt, hogy javítsa az automatizált felhasználói felület tesztelését azáltal, hogy megszünteti a töredezettségeket, növeli a végrehajtási sebességet, és betekintést nyújt a böngésző működésébe.

- Ez egy modern böngészőautomatizálási alkalmazás, amely sok szempontból hasonlítható a Puppeteerhez, és előre telepített kompatibilis böngészőkkel érkezik.

- Fő előnye a böngészők közötti kompatibilitás, mivel Chromium, WebKit és Firefox futtatására képes.

- A Playwright rendszeresen integrálódik a Docker, az Azure, a Travis CI és az AppVeyor szolgáltatásokkal.

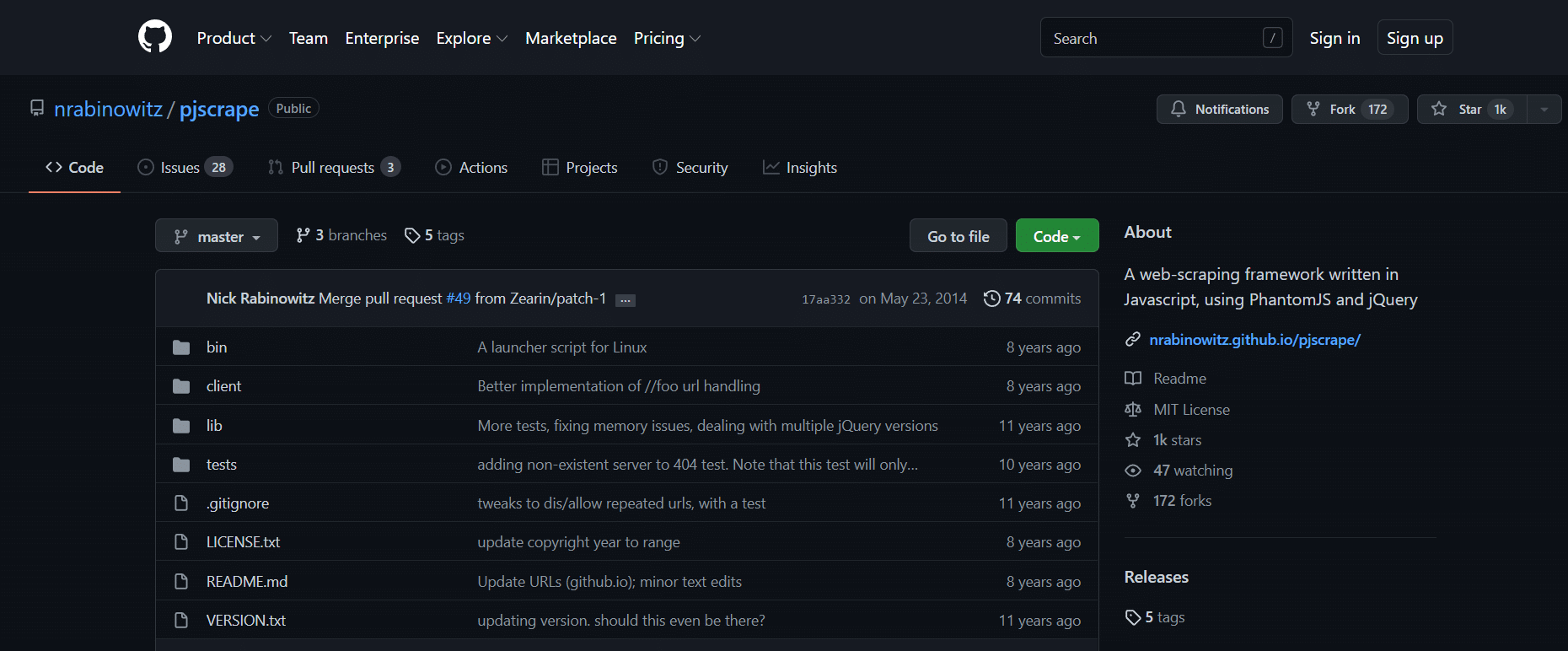

31. PJScrape

A PJscrape egy Python-alapú online kaparó eszközkészlet, amely Javascriptet és JQuery-t használ. Az alábbiakban bemutatjuk ennek az eszköznek a jellemzőit.

- Úgy tervezték, hogy működjön együtt a PhantomJS-szel, így a webhelyeket a parancssorból teljesen leképezve, Javascript-kompatibilis környezetben, böngésző nélkül is lekaparhatja.

- Ez azt jelenti, hogy nemcsak a DOM-hoz férhet hozzá, hanem a Javascript változóihoz és függvényeihez, valamint az AJAX-ba betöltött tartalomhoz is.

- A lehúzó funkciókat a teljes böngésző kontextusában értékelik.

***

Reméljük, hogy ez az útmutató hasznos volt a legjobb webkaparó eszközökkel kapcsolatban. Ossza meg velünk, melyik eszközt tartja egyszerűnek az Ön számára. Látogassa meg oldalunkat további jó tippekért és trükkökért, és írja meg megjegyzéseit alább.