Az olyan feltörekvő technológiák megjelenésével, mint a mély tanulás, az AI és az ML, a felhőalapú GPU-k iránt nagy a kereslet.

Ha szervezete 3D-s vizualizációkkal, gépi tanulással (ML), mesterséges intelligenciával (AI) vagy valamilyen nehéz számítástechnikával foglalkozik, nagyon sokat számít a GPU-számítás módja.

Hagyományosan a mély tanulási modellek a szervezetekben rengeteg időt vettek igénybe a képzési és számítási feladatok elvégzésére. Korábban megölte az idejüket, sokba került, és tárolási és helyproblémákat hagyott rájuk, csökkentve a termelékenységet.

Az új korú GPU-kat ennek a problémának a megoldására tervezték. Nagy hatékonyságot kínálnak a nehéz számítások párhuzamos végrehajtásához és gyorsabb betanításhoz AI modelljeihez.

Az Indigo kutatása szerint a GPU-k kínálhatnak 250-szer gyorsabb teljesítmény, mint a CPU-k, miközben a mély tanuláshoz kapcsolódó neurális hálózatokat tanítják.

A felhőalapú számítástechnika fejlődésével pedig olyan felhő GPU-ink vannak, amelyek átalakítják az adattudomány és más feltörekvő technológiák világát azáltal, hogy még gyorsabb teljesítményt, egyszerű karbantartást, alacsonyabb költségeket, gyors skálázást és időt takarítanak meg.

Ez a cikk bemutatja a felhőalapú GPU-koncepciókat, hogyan kapcsolódik ezekhez az AI-hoz, az ML-hez, a mély tanuláshoz, valamint néhány olyan legjobb felhőalapú GPU-platformhoz, amelyet a preferált felhő GPU-jának üzembe helyezéséhez találhat.

Kezdjük!

Tartalomjegyzék

Mi az a felhő GPU?

A felhőalapú GPU megértéséhez először beszéljünk a GPU-król.

A grafikus feldolgozó egység (GPU) egy speciális elektronikus áramkörre utal, amelyet a memória gyors megváltoztatására és manipulálására használnak a képek vagy grafikák létrehozásának felgyorsítása érdekében.

A modern GPU-k párhuzamos szerkezetüknek köszönhetően hatékonyabban kezelik a képfeldolgozást és a számítógépes grafikát, mint a központi feldolgozó egységek (CPU). A GPU be van ágyazva az alaplapjába, vagy a számítógép videokártyájára vagy CPU-kimenetére van elhelyezve.

A Cloud Graphics Unit (GPU) olyan számítógépes példányok robusztus hardveres gyorsítással, amelyek hasznosak az alkalmazások futtatásához, amelyek képesek kezelni a hatalmas mesterséges intelligencia és mély tanulási munkaterheléseket a felhőben. Nem szükséges fizikai GPU-t telepítenie az eszközére.

Néhány népszerű GPU az NVIDIA, AMD, Radeon, GeForce és még sok más.

A GPU-kat a következőkben használják:

- Mobiltelefonok

- Játék konzolok

- Munkaállomások

- Beágyazott rendszerek

- Személyi számítógépek

Mire használhatók a GPU-k:

Íme néhány GPU használati eset:

- AI-ban és ML-ben a képfelismeréshez

- Számítások 3D számítógépes grafikához és CAD rajzokhoz

- Textúra leképezés és sokszögek megjelenítése

- Geometriai számítások, mint például a csúcsok koordinátarendszerekbe történő fordítása és forgatása

- Programozható shaderek támogatása textúrák és csúcsok manipulálásához

- GPU-gyorsított videó kódolás, dekódolás és adatfolyam

- Grafikában gazdag játék és felhőalapú játék

- Széleskörű matematikai modellezés, elemzés és mély tanulás, amely az általános célú GPU-k párhuzamos feldolgozási képességeit igényli.

- Videószerkesztés, grafikai tervezés és tartalomkészítés

Mik a Cloud GPU-k előnyei? 👍

A Cloud GPU használatának fő előnyei a következők:

Nagyon skálázható

Ha bővíteni szeretné szervezetét, annak munkateher előbb-utóbb megnő. Olyan GPU-ra lesz szüksége, amely a megnövekedett munkaterheléssel skálázható. A felhőalapú GPU-k segíthetnek ebben azáltal, hogy lehetővé teszik további GPU-k egyszerű, gondok nélküli hozzáadását, így ki tudja elégíteni a megnövekedett munkaterhelést. Ezzel szemben, ha kicsinyíteni akarja, ez is gyorsan lehetséges.

Minimalizálja a költségeket

Ahelyett, hogy nagy teljesítményű fizikai GPU-kat vásárolna, amelyek hihetetlenül magas költségekkel járnak, bérelhet felhőalapú GPU-kat, amelyek óránként alacsonyabb áron érhetők el. A felhőalapú GPU-k használatának óraszáma után kell fizetnie, ellentétben a fizikaikkal, amelyek sokba kerültek volna, még akkor is, ha nem sokat használja őket.

Törli a helyi erőforrásokat

A felhőalapú GPU-k nem fogyasztják a helyi erőforrásokat, ellentétben a fizikai GPU-kkal, amelyek jelentős mennyiségű helyet foglalnak el a számítógépen. Arról nem is beszélve, hogy ha egy nagyszabású ML-modellt futtatsz vagy egy feladatot renderelsz, az lelassítja a számítógépedet.

Ennek érdekében megfontolhatja a számítási teljesítmény kiszervezését a felhőbe anélkül, hogy megterhelné a számítógépét, és könnyedén használhatja. Csak használja a számítógépet, hogy mindent vezéreljen, ahelyett, hogy minden nyomást adna rá a munkaterhelés és a számítási feladatok kezelésére.

Időt spórol

A felhőalapú GPU-k rugalmasságot biztosítanak a tervezőknek a gyors iterációhoz, gyorsabb renderelési idővel. Rengeteg időt takaríthat meg, ha percek alatt elvégez egy feladatot, amely korábban órákig vagy napokig tartott. Így a csapat termelékenysége jelentősen megnő, így Ön időt fektethet az innovációba a megjelenítés vagy a számítások helyett.

Hogyan segítenek a GPU-k a mély tanulásban és az AI-ban?

A mély tanulás a mesterséges intelligencia alapja. Ez egy fejlett ML technika, amely a reprezentációs tanulást hangsúlyozza a mesterséges neurális hálózatok (ANN) segítségével. A mély tanulási modellt nagy adathalmazok vagy nagy számításigényű folyamatok feldolgozására használják.

Szóval, hogyan jönnek a képbe a GPU-k?

A GPU-kat úgy tervezték, hogy párhuzamos számításokat vagy több számítást végezzenek egyidejűleg. A GPU-k kihasználhatják a mély tanulási modell képességét a nagy számítási feladatok felgyorsítására.

Mivel a GPU-k sok maggal rendelkeznek, kiváló párhuzamos feldolgozási számításokat kínálnak. Ezenkívül nagyobb memória sávszélességgel rendelkeznek, hogy hatalmas mennyiségű adatot fogadjanak el a mély tanulási rendszerek számára. Ezért széles körben használják mesterséges intelligencia-modellek betanítására, CAD-modellek renderelésére, grafikában gazdag videojátékok lejátszására és egyebekre.

Sőt, ha több algoritmussal szeretne kísérletezni egyidejűleg, több GPU-t is futtathat külön-külön. Megkönnyíti a különböző folyamatokat különálló GPU-kon párhuzamosság nélkül. Ehhez több GPU-t használhat különböző fizikai gépeken vagy egyetlen gépen a nehéz adatmodellek terjesztéséhez.

Hogyan kezdheti el a Cloud GPU-t

A felhő GPU-k használatának megkezdése nem rakétatudomány. Valójában minden egyszerű és gyors, ha megérti az alapokat. Először is ki kell választania egy felhő GPU-szolgáltatót, például a Google Cloud Platformot (GCP).

Ezután regisztráljon a GCP-re. Itt kihasználhatja a vele járó összes általános előnyt, például felhőfunkciókat, tárolási lehetőségeket, adatbáziskezelést, alkalmazásokkal való integrációt és még sok mást. Használhatja a Jupyter Notebookhoz hasonlóan működő Google Colboratory-jukat egy GPU INGYENES használatához. Végül elkezdheti a GPU-k renderelését az Ön használati esetéhez.

Tehát nézzük meg a felhőalapú GPU-k különféle lehetőségeit az AI és a hatalmas munkaterhelések kezelésére.

Linode

Linode igény szerinti GPU-kat kínál párhuzamos feldolgozási munkaterhelésekhez, mint például a videófeldolgozás, a tudományos számítástechnika, a gépi tanulás, az AI stb. GPU-ra optimalizált virtuális gépeket biztosít, amelyeket NVIDIA Quadro RTX 6000, Tensor, RT magok gyorsítanak, és a CUDA teljesítményét sugárkövetési munkaterhelések, mély tanulás és összetett feldolgozás végrehajtására használja fel.

Változtassa tőkekiadásait működési költségekké azáltal, hogy hozzáférést biztosít a Linode GPU-tól, hogy kihasználja a GPU teljesítményét, és élvezze a felhő valós értékajánlatát. Ráadásul a Linode lehetővé teszi, hogy az alapvető kompetenciákra koncentráljon ahelyett, hogy a hardver miatt aggódna.

A Linode GPU-k kiküszöbölik az akadályokat, hogy kihasználják azokat az összetett felhasználási esetekben, mint a videó streaming, az AI és a gépi tanulás. Ezenkívül minden példányhoz akár 4 kártyát is kaphat, attól függően, hogy mekkora lóerőre van szüksége a tervezett munkaterheléshez.

A Quadro RTX 6000 4608 CUDA magot, 576 Tensor magot, 72 RT magot, 24 GB GDDR6 GPU memóriát, 84T RTX-OPS-t, 10 Giga Rays/s Rays Cast-ot és 16,3 TFLOP FP32 teljesítményt tartalmaz.

A dedikált plusz RTX6000 GPU csomag ára 1,5 USD/óra.

Paperspace CORE

Töltsd fel szervezeti munkafolyamatát a következő generációs gyorsított számítási infrastruktúrával Paperspace CORE. Könnyen használható és áttekinthető felületet kínál az egyszerű beépítéshez, együttműködési eszközökhöz és asztali alkalmazásokhoz Mac, Linux és Windows rendszerekhez. Használja nagy igényű alkalmazások futtatására korlátlan számítási teljesítményen keresztül.

A CORE villámgyors hálózatot, azonnali hozzáférést, 3D-s alkalmazások támogatását és teljes API-t biztosít a programozott hozzáféréshez. Teljes képet kaphat infrastruktúrájáról egy egyszerű és intuitív grafikus felhasználói felülettel egyetlen helyen. Ráadásul a CORE felügyeleti felületével kiváló irányítás érhető el, amely robusztus eszközöket tartalmaz, és lehetővé teszi a gépek, hálózatok és felhasználók szűrését, rendezését, csatlakoztatását vagy létrehozását.

A CORE hatékony felügyeleti konzolja gyorsan végrehajtja a feladatokat, például az Active Directory integráció vagy a VPN hozzáadását. Az összetett hálózati konfigurációkat is egyszerűen kezelheti, és néhány kattintással gyorsabban elvégezheti a dolgokat.

Ezenkívül számos olyan integrációt találhat, amelyek nem kötelezőek, de hasznosak a munkájában. Fejlett biztonsági funkciókat, megosztott meghajtókat és még sok mást kaphat ezzel a felhőalapú GPU platformmal. Élvezze az alacsony költségű GPU-kat: oktatási kedvezményeket, számlázási figyelmeztetéseket, egy másodperces számlázást stb.

Egyszerűsítse és gyorsítsa a munkafolyamatot 0,07 USD/óra induló áron.

Google Cloud GPU-k

Szerezzen be nagy teljesítményű GPU-kat tudományos számítástechnikához, 3D-s megjelenítéshez és gépi tanuláshoz Google Cloud GPU-k. Segíthet felgyorsítani a HPC-t, kiválasztani a GPU-k széles skáláját az árakhoz és a teljesítményhez igazodva, valamint minimalizálni a munkaterhelést a gépek testreszabásával és rugalmas árazással.

Számos GPU-t is kínálnak, például NVIDIA K80, P4, V100, A100, T4 és P100. Ráadásul a Google Cloud GPU-k egyensúlyban tartják a memóriát, a processzort, a nagy teljesítményű lemezt és az akár 8 GPU-t minden esetben az egyéni munkaterheléshez.

Ezenkívül hozzáférést kap az iparágvezető hálózatokhoz, adatelemzésekhez és tároláshoz. A GPU-eszközök bizonyos régiókban csak meghatározott zónákban érhetők el. Az ár a régiótól, a választott GPU-tól és a gép típusától függ. Az árat úgy számíthatja ki, hogy meghatározza igényeit a Google Cloud árkalkulátorban.

Alternatív megoldásként használhatja az alábbi megoldásokat:

Elasztikus GPU szolgáltatás

Elasztikus GPU szolgáltatás (EGS) párhuzamos és nagy teljesítményű számítási lehetőségeket biztosít a GPU technológiával. Ideális számos forgatókönyvhöz, például videófeldolgozáshoz, vizualizációhoz, tudományos számítástechnikához és mély tanuláshoz. Az EGS számos GPU-t használ, például NVIDIA Tesla M40, NVIDIA Tesla V100, NVIDIA Tesla P4, NVIDIA Tesla P100 és AMD FirePro S7150.

Olyan előnyökhöz juthat, mint az online mélytanulási következtetési szolgáltatások és képzés, a tartalomazonosítás, a kép- és hangfelismerés, a HD médiakódolás, a videokonferencia, a forrásfilm-javítás és a 4K/8K HD élőkép.

Ezenkívül olyan lehetőségeket kaphat, mint a videomegjelenítés, a számítási finanszírozás, az éghajlat-előrejelzés, az ütközésszimuláció, a géntechnológia, a nemlineáris szerkesztés, a távoktatási alkalmazások és a mérnöki tervezés.

- A GA1 példány akár 4 AMD FirePro S7150 GPU-t, 160 GB memóriát és 56 vCPU-t biztosít. 8192 magot és 32 GB GPU memóriát tartalmaz, amely párhuzamosan működik, és 15 TFLOPS egyszeri és egy TFLOPS dupla pontosságot biztosít.

- A GN4 példány akár 2 NVIDIA Tesla M40 GPU-t, 96 GB memóriát és 56 vCPU-t biztosít. 6000 magot és 24 GB GPU memóriát tartalmaz, amely 14 TFLOPS egyszeri pontosságot biztosít. Hasonlóképpen számos példányt talál, például GN5, GN5i és GN6.

- Az EGS 25 Gbit/s és akár 2 000 000 PPS hálózati sávszélességet támogat belsőleg, hogy a számítási csomópontok számára szükséges maximális hálózati teljesítményt biztosítsa. Nagy sebességű helyi gyorsítótárral rendelkezik, amely SSD-vel vagy ultra felhőlemezekkel van csatlakoztatva.

- A nagy teljesítményű NVMe meghajtók 230 000 IOPS-t kezelnek 200 𝝻s I/O késleltetéssel, és 1900 Mbit/s olvasási és 1100 Mbit/s írási sávszélességet biztosítanak.

Különböző beszerzési lehetőségek közül választhat az igényeinek megfelelően, hogy megszerezze a forrásokat, és csak ezért fizessen.

Azure N sorozat

Azure N sorozat az Azure Virtual Machines (VM) közül GPU-képességekkel rendelkezik. A GPU-k ideálisak a grafikus és számításigényes munkaterhelésekhez, segítve a felhasználókat az innováció felgyorsításában különféle forgatókönyveken keresztül, mint például a mélytanulás, a prediktív elemzés és a távoli vizualizáció.

A különböző N sorozatoknak külön ajánlatuk van az adott munkaterheléshez.

- Az NC sorozat a nagy teljesítményű gépi tanulásra és a számítástechnikai terhelésekre összpontosít. A legújabb verzió az NCsv3, amely az NVIDIA’sNVIDIA Tesla V100 GPU-ját tartalmazza.

- Az ND sorozat a következtetésekre és a képzési forgatókönyvekre összpontosít, alapvetően a mély tanuláshoz. NVIDIA Tesla P40 GPU-kat használ. A legújabb verzió az NDv2, amely NVIDIA Tesla V100 GPU-kat tartalmaz.

- Az NV sorozat a távoli vizualizációra és az NVIDIA Tesla M60 GPU-val támogatott egyéb intenzív alkalmazások munkaterhelésére összpontosít.

- Az NC, NCsv3, ND és NCsv2 virtuális gépek InfiniBand összekapcsolást kínálnak, amely lehetővé teszi a teljesítmény növelését. Itt olyan előnyöket élvezhet, mint a mély tanulás, a grafikai megjelenítés, a videószerkesztés, a játékok stb.

IBM Cloud

IBM Cloud rugalmasságot, teljesítményt és számos GPU-lehetőséget kínál. Mivel a GPU az a plusz agyerő, amely hiányzik a CPU-ból, az IBM Cloud segítségével közvetlenül hozzáférhet a kiszolgáló könnyebben elérhető választékához, hogy zökkenőmentesen integrálódjon az IBM Cloud architektúrával, alkalmazásokkal és API-kkal, valamint az adatközpontok elosztott hálózatával világszerte.

- Csupasz fém szerver GPU opciókat kap, mint például Intel Xeon 4210, NVIDIA T4 grafikus kártya, 20 mag, 32 GB RAM, 2,20 GHz és 20 TB sávszélesség. Hasonlóképpen az Intel Xeon 5218 és az Intel Xeon 6248 opciókat is megkapja.

- A virtuális szerverekhez AC1.8×60-at kap, amely nyolc vCPU-val, 60 GB RAM-mal és 1 x P100 GPU-val rendelkezik. Itt az AC2.8×60 és az AC2.8×60 opciókat is megkapja.

Szerezze be a csupasz fém szerver GPU-t havi 819 USD-s, a virtuális szerver GPU-t pedig 1,95 USD/óra kikiáltási áron.

AWS és NVIDIA

AWS és NVIDIA együttműködtek, hogy folyamatosan költséghatékony, rugalmas és nagy teljesítményű GPU-alapú megoldásokat kínáljanak. Tartalmaz NVIDIA GPU-val hajtott Amazon EC2 példányokat és szolgáltatásokat, mint például az AWS IoT Greengrass, amely NVIDIA Jetson Nano modulokkal telepíthető.

A felhasználók az AWS-t és az NVIDIA-t használják virtuális munkaállomásokhoz, gépi tanuláshoz (ML), IoT-szolgáltatásokhoz és nagy teljesítményű számítástechnikához. Az NVIDIA GPU-val ellátott Amazon EC2 példányok felelősek a méretezhető teljesítményért. Ezenkívül az AWS IoT Greengrass használatával kiterjesztheti az AWS felhőszolgáltatásokat az NVIDIA-alapú éleszközökre.

Az NVIDIA A100 Tensor Core GPU-k az Amazon EC2 P4d példányait táplálják, így iparágvezető alacsony késleltetésű hálózatkezelést és nagy átviteli sebességet biztosítanak. Hasonlóképpen sok más példányt is találhat bizonyos forgatókönyvekhez, például Amazon EC2 P3, Amazon EC2 G4 stb.

Jelentkezzen az INGYENES próbaverzióra, és tapasztalja meg a GPU erejét a felhő szélén.

OVHcloud

OVHcloud felhőszervereket biztosít, amelyeket hatalmas párhuzamos munkaterhelések feldolgozására terveztek. A GPU-k számos példányát integrálták NVIDIA Tesla V100 grafikus processzorokkal, hogy megfeleljenek a mély tanulási és gépi tanulási igényeknek.

Segítenek a számítástechnika felgyorsításában a grafikus számítástechnika területén, valamint a mesterséges intelligencia területén. Az OVH együttműködik az NVIDIA-val, hogy a legjobb GPU-gyorsított platformot kínálja a nagy teljesítményű számítástechnikához, mesterséges intelligenciához és mély tanuláshoz.

Használja a legegyszerűbb módszert a GPU-gyorsított tárolók üzembe helyezésére és karbantartására egy teljes katalóguson keresztül. A négy kártya egyikét közvetlenül a PCI Passthrough-n keresztül juttatja el a példányokhoz, virtualizációs réteg nélkül, hogy minden erőt az Ön használatára fordítson.

Az OVHcloud szolgáltatásai és infrastruktúrái ISO/IEC 27017, 27001, 27701 és 27018 tanúsítvánnyal rendelkeznek. A tanúsítványok azt jelzik, hogy az OVHcloud információbiztonsági menedzsment rendszerrel (ISMS) rendelkezik a sebezhetőségek kezelésére, az üzletmenet-folytonosság megvalósítására, a kockázatok kezelésére, valamint egy adatvédelmi információkezelési rendszer (PIMS) bevezetésére.

Ezenkívül az NVIDIA Tesla V100 számos értékes funkcióval rendelkezik, például PCIe 32 GB/s, 16 GB HBM2 kapacitás, 900 GB/s sávszélesség, dupla precizitású 7 teraFLOP, egyszeres precíziós 14 teraFLOP és mély tanulási képesség – 112 teraFLOP.

Lambda GPU

Tanítson mély tanulási, ML és AI modelleket ezzel Lambda GPU felhő és néhány kattintással méretezhető a gépről a virtuális gépek teljes számára. Szerezze be az előre telepített fő keretrendszereket és a lambda Stack legújabb verzióját, amely CUDA illesztőprogramokat és mély tanulási keretrendszereket tartalmaz.

Gyorsan hozzáférhet a dedikált Jupyter Notebook fejlesztőkörnyezethez minden géphez az irányítópultról. Használja az SSH-t közvetlenül az egyik SSH-kulccsal, vagy csatlakozzon a webterminálon keresztül a felhő-műszerfalon a közvetlen eléréshez.

Minden példány legfeljebb 10 Gbps csomópontok közötti sávszélességet támogat, amely lehetővé teszi a szórt képzést olyan keretrendszerekkel, mint a Horovod. Időt takaríthat meg a modelloptimalizálás során is, ha a GPU-k számát egy vagy több példányban méretezi.

A Lambda GPU Cloud segítségével akár 50%-ot is megtakaríthat a számítástechnikán, csökkentheti a felhő TCO-ját, és soha nem fog több évre szóló kötelezettségeket vállalni. Használjon egyetlen RTX 6000 GPU-t hat VCPU-val, 46 GiB RAM-mal, 658 GiB ideiglenes tárhellyel, mindössze 1,25 USD/óra áron. Válasszon sok példány közül igényei szerint, hogy igény szerinti árat kapjon a használatáért.

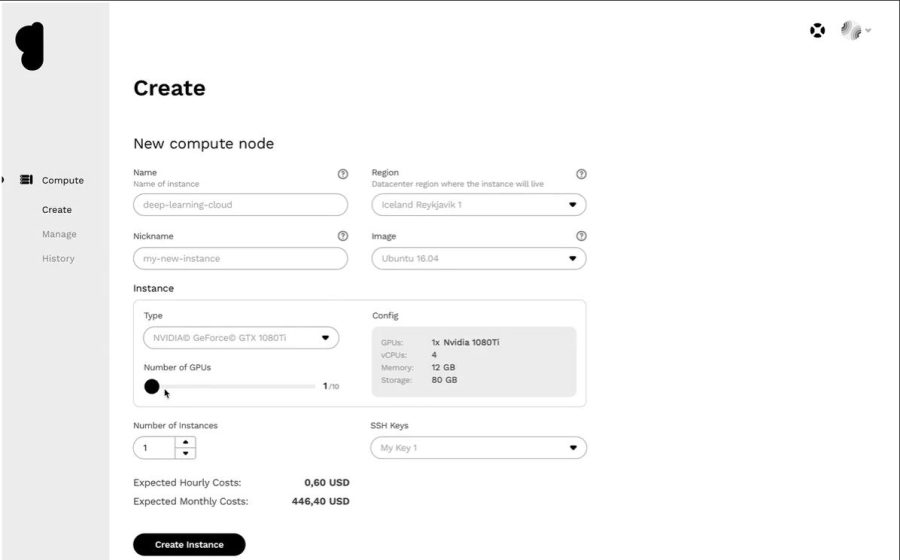

Genesis felhő

Szerezzen be egy hatékony felhőalapú GPU-platformot nagyon kedvező áron Genesis felhő. Számos hatékony adatközponthoz férnek hozzá szerte a világon, amelyekkel együttműködve az alkalmazások széles skáláját kínálják.

Minden szolgáltatás biztonságos, méretezhető, robusztus és automatizált. A Genesis Cloud korlátlan GPU számítási teljesítményt biztosít vizuális effektusokhoz, gépi tanuláshoz, átkódoláshoz vagy tároláshoz, Big Data elemzéséhez és még sok máshoz.

A Genesis Cloud számos gazdag funkciót kínál INGYEN, például pillanatképeket a munka mentéséhez, biztonsági csoportokat a hálózati forgalomhoz, tárhelyet a nagy adathalmazokhoz, FastAI-t, PyTorch-ot, előre konfigurált képeket és nyilvános API-t a TensorFlow számára.

Különböző típusú NVIDIA és AMD GPU-kkal rendelkezik. Ezenkívül a neurális hálózat képzése vagy animációs filmek létrehozása a GPU-számítási képességek kihasználásával. Adatközpontjaik 100%-ban geotermikus forrásokból származó megújuló energiával működnek a szén-dioxid-kibocsátás csökkentése érdekében.

Áraik 85%-kal alacsonyabbak, mint más szolgáltatóknál, mivel Ön a percenkénti növekményért fizet. Többet is megtakaríthat a hosszú távú és előrevethető kedvezményekkel.

Következtetés 👩🏫

A Cloud GPU-kat úgy tervezték, hogy hihetetlen teljesítményt, sebességet, skálázást, helyet és kényelmet kínáljanak. Ezért fontolja meg az előnyben részesített felhőalapú GPU-platform kiválasztását készenléti képességekkel, hogy felgyorsítsa a mélytanulási modelleket és könnyen kezelje az AI-terheléseket.